隨著生成式人工智能(Generative AI)以前所未有的速度滲透到各行各業,其帶來的生產力變革與創新潛力令人振奮。其廣泛采用也面臨著嚴峻挑戰:如何確保訓練數據、核心模型參數、用戶輸入及生成輸出的高度機密性與完整性?在這一背景下,機密計算(Confidential Computing)正從一項前沿技術,演變為確保生成式AI可信、安全、合規采用的關鍵基石。

一、生成式AI的采用瓶頸:數據與模型的安全隱憂

生成式AI,尤其是大語言模型(LLM),其開發與運營全周期都涉及敏感信息:

- 訓練數據隱私:訓練數據可能包含個人身份信息、商業機密或受版權保護的內容,泄露風險極高。

- 模型資產安全:經過巨量資源訓練得出的模型權重和架構是企業的核心知識產權,亟需防止竊取或篡改。

- 推理數據保護:用戶與AI交互的輸入(如企業財務數據、醫療記錄、源代碼)和AI的生成輸出,同樣需要嚴格保密。

- 合規性要求:全球各地日益嚴格的數據保護法規(如GDPR、HIPAA)要求數據“靜默”(at rest)、“傳輸”(in transit)和“使用”(in use)時均得到保護。傳統加密技術能解決前兩者,但數據在內存中明文計算時,仍暴露于操作系統、運維人員或其他惡意軟件的攻擊面之下。

二、機密計算:定義與核心技術原理

機密計算是一種通過硬件創建受保護、隔離的可信執行環境(Trusted Execution Environment, TEE),確保敏感數據在使用(即計算)過程中,始終處于加密或不可訪問狀態的技術。其核心在于:

- 硬件級隔離:利用CPU(如Intel SGX、AMD SEV、ARM TrustZone)或專用安全芯片創建“飛地”(Enclave),其內存區域與主機操作系統、虛擬機監控程序乃至擁有物理權限的管理員隔離。

- 遠程證明:允許用戶或服務在部署前,遠程驗證TEE環境及其內部運行代碼的真實性與完整性,確保其未被篡改。

- 內存加密:TEE內的數據在CPU外(如內存、總線)始終保持加密狀態,僅在CPU內部解密處理。

三、機密計算如何賦能生成式AI的安全采用

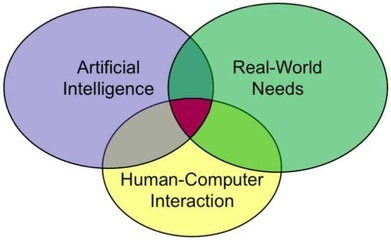

通過將機密計算深度集成到生成式AI的產品技術開發流程中,可以在多個層面構建端到端的信任鏈:

1. 保護訓練數據與聯合學習

在需要利用多方敏感數據進行模型訓練或微調時(如醫療、金融領域),機密計算TEE可以創建一個中立、安全的“黑箱”計算環境。各參與方將加密數據送入TEE,訓練在隔離環境中進行,任何一方(包括基礎設施提供商)都無法窺探原始數據,從而在保護隱私的前提下釋放數據價值,促進更高質量模型的開發。

2. 保障模型知識產權與安全部署

企業可以將訓練好的專有AI模型以加密形式部署在云端或邊緣的TEE中。模型權重僅在TEE內部解密并運行,有效防止模型被竊取、逆向工程或非法復制。這為AI即服務(AIaaS)商業模式提供了堅實的安全基礎,使模型所有者敢于將核心資產部署在第三方基礎設施上。

3. 確保推理過程的端到端機密性

用戶可以將加密的查詢請求直接發送至運行在TEE內的AI模型。整個推理過程——從接收加密輸入、解密處理、生成結果到加密輸出——完全在受保護環境中完成。服務提供商只能看到加密的數據流,無法獲取用戶的私密對話或企業的機密信息,極大增強了用戶信任。

4. 實現可驗證的合規與審計

借助遠程證明和TEE的完整性度量,企業可以向監管機構或客戶提供密碼學證明,證實其AI服務確實運行在符合安全標準的可信環境中,且處理邏輯未被篡改。這為滿足GDPR等法規中的數據最小化原則和處理透明度要求提供了技術可行路徑。

四、技術開發現狀、挑戰與未來展望

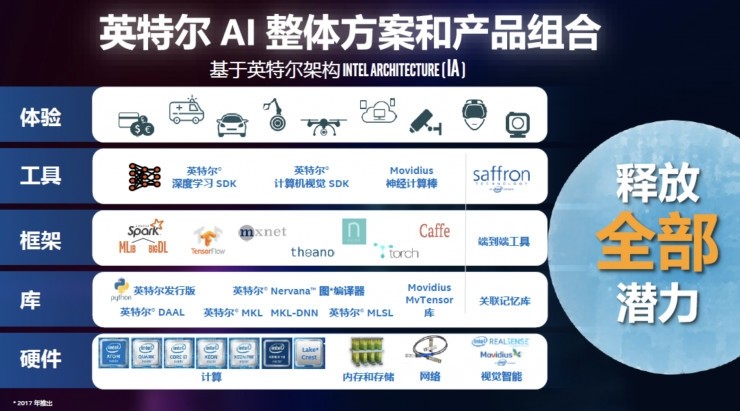

開發現狀:主流云服務商(AWS Nitro Enclaves, Azure Confidential Computing, Google Confidential VM)和硬件廠商已提供成熟的機密計算服務與平臺。開源框架(如Open Enclave SDK)和庫正在降低集成門檻。一些前沿項目已開始探索在TEE內運行大型模型推理。

當前挑戰:

- 性能開銷:內存加密和隔離機制會帶來一定的計算延遲與吞吐量損失,對計算密集的生成式AI是一大挑戰。

- 開發復雜性:需要將應用程序分割為可信與不可信部分,對現有AI工作流進行重構。

- TEE生態系統成熟度:不同硬件平臺的TEE實現互操作性仍需加強,大規模管理TEE集群的工具鏈有待完善。

- 信任根轉移:雖然降低了對云服務商的信任依賴,但將信任轉移到了硬件廠商和TEE設計本身。

未來展望:

隨著硬件性能提升(如專用AI安全芯片)、軟件棧優化以及行業標準的形成,機密計算將與同態加密、安全多方計算等隱私增強技術(PETs)結合,形成多層次防御。我們有望看到“機密AI”成為云AI服務的默認選項,特別是在醫療、法律、金融和政務等高度敏感領域,為生成式AI的全面、負責任采用掃清最關鍵的安全障礙。

###

生成式人工智能的潛力釋放,離不開信任的建立。機密計算通過硬件強制的隔離與驗證,為數據和模型在“使用中”提供了前所未有的保護級別。對于AI產品技術開發者而言,及早將機密計算納入架構考量,不僅是應對合規的必需,更是構建差異化競爭優勢、贏得市場信任的戰略選擇。它并非解決所有安全問題的銀彈,但無疑是構建下一代可信人工智能生態不可或缺的核心支柱。