近期,我國正式發布了新一代人工智能治理原則,標志著我國在人工智能領域的治理體系建設邁出了關鍵一步。這一系列治理原則的出臺,不僅為人工智能技術的健康發展提供了明確的指導方向,也為后續相關立法工作奠定了重要基礎。

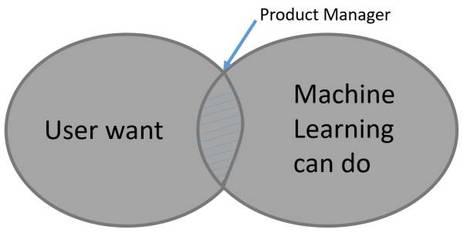

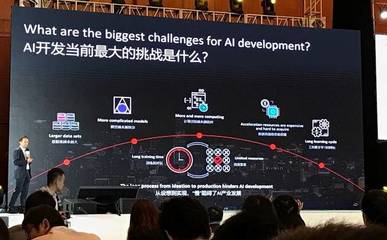

人工智能作為引領未來的戰略性技術,正深入滲透到經濟社會發展的各個領域。隨著AI技術的快速發展和廣泛應用,數據隱私、算法公平、安全可控等問題日益凸顯。為此,新一代治理原則明確提出要以促進創新發展、智能向善為導向,堅持人類共同福祉優先,確保人工智能技術發展符合社會主義核心價值觀和法律法規要求。

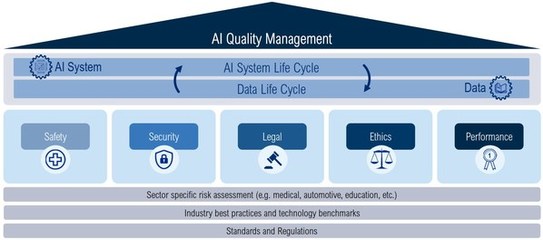

在技術開發層面,治理原則特別強調了安全可信和公平公正的重要性。要求AI產品研發過程中必須建立全生命周期安全管理機制,加強數據安全和隱私保護,確保算法決策的透明性和可解釋性。同時,治理原則還倡導建設包容普惠的人工智能體系,防止技術發展導致新的數字鴻溝。

此次治理原則的發布,為人工智能立法工作提供了重要參考。通過明確技術研發和應用的倫理邊界、責任劃分等關鍵問題,為制定更加完善的人工智能法律法規創造了有利條件。未來,我國還將在此基礎上進一步完善人工智能治理體系,推動建立與國際接軌又具中國特色的AI治理模式。

可以預見,隨著治理原則的落地實施,我國人工智能產業將進入更加規范、有序的發展階段。這不僅有利于保護用戶權益,維護國家安全,也將為全球人工智能治理貢獻中國智慧和中國方案。在治理原則的指引下,我國人工智能技術開發將更好地服務于經濟高質量發展和人民美好生活需要。